Anthropic vs Pentagono: Quando l'AI Dice No alla Guerra Senza Limiti

Lo scontro Anthropic Pentagono sull'etica dell'AI: un contratto da $200M perso, la designazione di rischio per la catena di approvvigionamento e la battaglia su armi autonome e sorveglianza di massa.

IN PRIMA PAGINAAIINNOVAZIONE E TECNOLOGIE EMERGENTICULTURA E FILOSOFIA DIGITALE

Anthropic vs Pentagono:

Quando l'AI Dice No alla Guerra Senza Limiti

"Queste minacce non cambiano la nostra posizione: non possiamo in buona coscienza accogliere la loro richiesta." - Dario Amodei, CEO di Anthropic

Venerdì 27 febbraio 2026, alle 17:01 ora della costa orientale degli Stati Uniti, è scaduto un ultimatum. Non tra nazioni in guerra, non tra potenze nucleari ai lati opposti di un confine. Tra il Dipartimento della Difesa più potente del mondo e un'azienda di San Francisco che costruisce intelligenza artificiale.

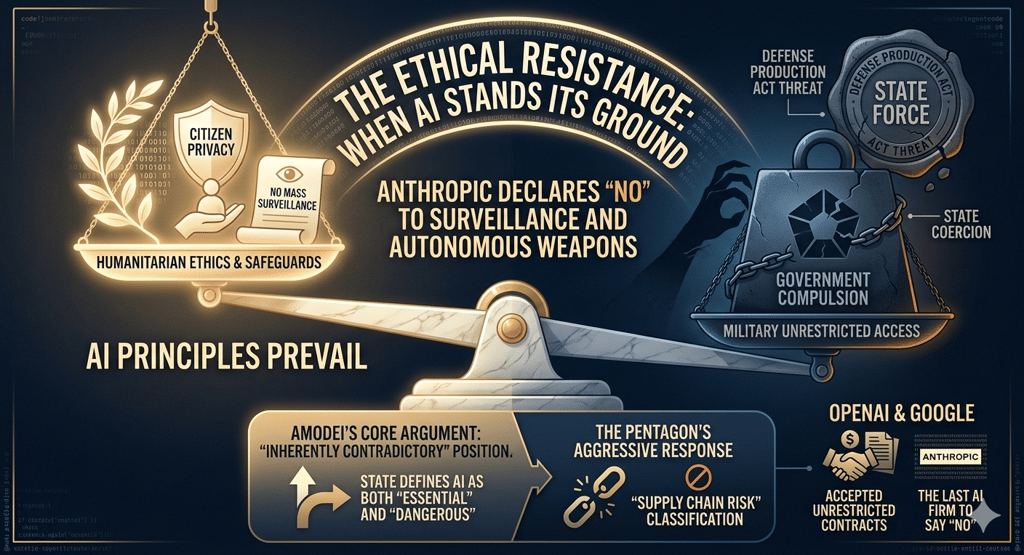

Da un lato, il Segretario alla Difesa Pete Hegseth, che pretende accesso illimitato a Claude , il modello AI più avanzato mai deployato sulle reti classificate del Pentagono. Dall'altro, Dario Amodei, CEO di Anthropic, che rifiuta di rimuovere due sole clausole dal contratto: il divieto di usare la sua AI per la sorveglianza di massa dei cittadini americani e per armi completamente autonome.

La risposta del governo? Un'escalation senza precedenti nella storia del rapporto tra Silicon Valley e il complesso militare-industriale.

Trump ha ordinato a tutte le agenzie federali di cessare immediatamente l'uso dei prodotti Anthropic. Hegseth ha classificato l'azienda come "rischio per la catena di approvvigionamento della sicurezza nazionale" , una designazione riservata fino ad oggi a nemici stranieri come Huawei e Kaspersky, mai applicata a un'azienda americana. E poche ore dopo, OpenAI ha annunciato di aver ottenuto esattamente quel contratto per le reti classificate del Pentagono che Anthropic stava perdendo.

Questa non è solo una disputa contrattuale. È il momento in cui la domanda che ci portiamo dietro dall'alba dell'era digitale , chi controlla la tecnologia: chi la costruisce o chi la usa? , ha smesso di essere teorica.

1. I Fatti: Anatomia di uno Scontro

1.1 Il contratto da 200 milioni di dollari

Nel luglio 2025, Anthropic ha firmato un contratto del valore massimo di 200 milioni di dollari con il Dipartimento della Difesa statunitense. Un accordo storico: Claude è stato il primo modello di intelligenza artificiale di frontiera ad essere deployato sulle reti classificate del Pentagono, battendo Google Gemini e OpenAI ChatGPT nella corsa all'accreditamento di sicurezza.

L'ambito d'uso era ampio: analisi di intelligence, modellazione e simulazione, pianificazione operativa, operazioni cyber. Claude è stato utilizzato in operazioni concrete , secondo Axios, anche nell'operazione per la cattura dell'ex presidente venezuelano Nicolás Maduro.

Ma nel contratto c'erano due clausole, inserite nella Acceptable Use Policy di Anthropic, che avrebbero cambiato tutto: il divieto di utilizzo per la sorveglianza di massa dei cittadini americani e per armi completamente autonome , quelle che selezionano e ingaggiano bersagli senza alcun intervento umano.

1.2 L'ultimatum

A inizio 2026, il Pentagono , ribattezzato dall'amministrazione Trump "Department of War" (Dipartimento della Guerra) in un ritorno alla denominazione pre-1947 , ha stabilito una nuova policy: tutti i fornitori di AI devono rendere i propri modelli disponibili per "tutti gli usi leciti" (all lawful purposes), senza eccezioni dettate dall'azienda.

Per Anthropic, questo significava rimuovere le due clausole. L'azienda ha rifiutato.

Il 24 febbraio, durante un incontro al Pentagono tra il Segretario Hegseth e Amodei , descritto dalle fonti come "cordiale" , Hegseth ha consegnato un ultimatum: accettare entro le 17:01 di venerdì 27 febbraio, o affrontare le conseguenze.

Le conseguenze minacciate erano tre, e tutte senza precedenti:

Cancellazione del contratto da 200 milioni di dollari

Designazione come "supply chain risk" , etichetta che obbligherebbe ogni contractor militare a certificare di non utilizzare prodotti Anthropic

Invocazione del Defense Production Act , una legge del 1950, pensata per emergenze belliche, che consente al presidente di costringere aziende private a fornire prodotti al governo

Come ha notato Amodei nella sua dichiarazione pubblica del 26 febbraio, queste ultime due minacce sono "intrinsecamente contraddittorie: una ci etichetta come rischio per la sicurezza; l'altra etichetta Claude come essenziale per la sicurezza nazionale."

1.3 La risposta di Anthropic

Il 26 febbraio, Amodei ha pubblicato una dichiarazione sul sito di Anthropic che vale la pena analizzare nel dettaglio, perché è un documento raro: un CEO della Silicon Valley che sceglie pubblicamente di perdere centinaia di milioni di dollari piuttosto che cedere su principi etici.

Amodei ha elencato le credenziali patriottiche dell'azienda: prima azienda AI a deployare modelli sulle reti classificate del governo, prima ai Laboratori Nazionali, prima a fornire modelli personalizzati per clienti della sicurezza nazionale. Ha ricordato di aver rinunciato a centinaia di milioni di dollari di ricavi tagliando l'accesso a Claude alle aziende legate al Partito Comunista Cinese. Ha sottolineato di non aver mai sollevato obiezioni su specifiche operazioni militari.

Ma sulle due clausole, nessun compromesso. Le motivazioni, secondo Amodei, sono duplici:

Sulla sorveglianza di massa domestica: l'AI rende possibile assemblare automaticamente e su scala massiva dati sparsi e individualmente innocui , localizzazione, cronologia web, associazioni personali , in un quadro completo della vita di qualsiasi persona. Il governo può già acquistare legalmente questi dati da fonti pubbliche senza mandato, una pratica che la stessa Intelligence Community ha riconosciuto solleva preoccupazioni sulla privacy.

Sulle armi completamente autonome: i modelli AI di frontiera attuali semplicemente "non sono abbastanza affidabili" per essere usati in armi che tolgono completamente l'umano dal ciclo decisionale. Anthropic ha offerto di collaborare direttamente con il Pentagono sulla ricerca per migliorare l'affidabilità di questi sistemi, ma l'offerta è stata rifiutata.

Nella notte tra il 26 e il 27 febbraio, il Pentagono ha inviato ad Anthropic quella che ha definito la sua "migliore e ultima offerta" contrattuale. Anthropic l'ha respinta, dichiarando che il nuovo linguaggio "non faceva virtualmente alcun progresso" sulle due clausole e che le nuove formulazioni presentate come compromesso "erano accompagnate da cavilli legali che avrebbero permesso di ignorare quelle salvaguardie a piacimento."

1.4 La rappresaglia

Venerdì 27 febbraio, circa un'ora prima della scadenza dell'ultimatum, Trump ha scritto su Truth Social:

"I pazzi di estrema sinistra di Anthropic hanno fatto un ERRORE DISASTROSO cercando di FORZARE LA MANO al Dipartimento della Guerra, e costringerli a obbedire ai loro Termini di Servizio invece che alla nostra Costituzione. Pertanto, ordino a OGNI Agenzia Federale degli Stati Uniti di CESSARE IMMEDIATAMENTE ogni uso della tecnologia di Anthropic."

Ha concesso sei mesi per la transizione. Ha aggiunto che Anthropic "farebbe meglio a collaborare durante questa fase, o userò il Pieno Potere della Presidenza per costringerli a conformarsi, con gravi conseguenze civili e penali."

Poco dopo la scadenza delle 17:01, Hegseth ha pubblicato il colpo di grazia su X:

"In concomitanza con la direttiva del Presidente, ordino al Dipartimento della Guerra di designare Anthropic come Rischio per la Catena di Approvvigionamento della Sicurezza Nazionale. Con effetto immediato, nessun contractor, fornitore o partner che ha rapporti commerciali con le forze armate degli Stati Uniti può condurre alcuna attività commerciale con Anthropic."

E poi: "I combattenti americani non saranno mai tenuti in ostaggio dai capricci ideologici delle Big Tech. Questa decisione è definitiva."

Nella stessa giornata, Emil Michael , Sottosegretario alla Difesa per la Ricerca e l'Ingegneria, ed ex dirigente di Uber , ha scritto su X che Amodei "è un bugiardo con un complesso di Dio" che "non vuole altro che controllare personalmente l'esercito americano."

Un dettaglio rivelato da Axios rende la scena ancora più surreale: Michael stava ancora al telefono con Anthropic per offrire un accordo nel momento stesso in cui Hegseth twittava la designazione come supply chain risk. L'accordo che Michael stava proponendo avrebbe richiesto di consentire la raccolta e l'analisi di dati sugli americani , dalla geolocalizzazione alla cronologia web fino alle informazioni finanziarie acquistate da data broker.

1.5 Anthropic risponde

Nella serata del 27 febbraio, Anthropic ha rilasciato una seconda dichiarazione in cui:

Ha definito la designazione "un'azione senza precedenti , storicamente riservata ad avversari degli Stati Uniti, mai applicata pubblicamente a un'azienda americana"

Ha dichiarato che la mossa è "giuridicamente infondata" e che "creerebbe un pericoloso precedente per qualsiasi azienda americana che negozia con il governo"

Ha annunciato che impugnerà la designazione in tribunale

Ha contestato l'autorità legale di Hegseth di vietare a tutti i contractor militari di fare affari con Anthropic, specificando che la legge (10 USC 3252) limita la designazione "all'uso di Claude nell'ambito dei contratti con il Dipartimento della Guerra , non può influenzare il modo in cui i contractor usano Claude per servire altri clienti"

Ha rassicurato clienti individuali e commerciali che il loro accesso a Claude è "completamente inalterato"

Un passaggio merita attenzione particolare: "Nessuna quantità di intimidazione o punizione da parte del Dipartimento della Guerra cambierà la nostra posizione sulla sorveglianza di massa domestica o sulle armi completamente autonome."

2. OpenAI Entra in Scena (nel Momento Perfetto)

Poche ore dopo la designazione di Anthropic come rischio per la sicurezza nazionale, nella serata di venerdì 27 febbraio, il CEO di OpenAI Sam Altman ha annunciato su X che la sua azienda aveva raggiunto un accordo con il Pentagono per deployare i propri modelli sulle reti classificate , esattamente lo spazio lasciato vuoto da Anthropic.

Il tempismo è chirurgico. Ma la parte davvero interessante è nel dettaglio.

Altman ha dichiarato che l'accordo con il Pentagono contiene le stesse due limitazioni su cui Anthropic aveva costruito la propria battaglia: niente sorveglianza di massa dei cittadini americani, niente armi completamente autonome. Ha scritto: "Due dei nostri principi di sicurezza più importanti sono le proibizioni sulla sorveglianza di massa domestica e la responsabilità umana nell'uso della forza, inclusi i sistemi d'arma autonomi. Il Pentagono è d'accordo con questi principi, li riflette nelle leggi e nelle policy, e li abbiamo inseriti nel nostro accordo."

Come è possibile che il Pentagono accetti da OpenAI esattamente ciò che ha rifiutato da Anthropic?

La differenza, secondo Fortune, è nella formulazione contrattuale. Anthropic ha cercato di inserire i divieti esplicitamente nel contratto come clausole vincolanti. OpenAI ha invece accettato che il Pentagono possa usare la sua tecnologia per "qualsiasi scopo lecito" , contemporaneamente dichiarando di aver "inserito" le due limitazioni nell'accordo, apparentemente con un meccanismo diverso.

In sostanza: le stesse "red line" di Anthropic, ma espresse in un linguaggio che permette al Pentagono di dire di aver ottenuto "accesso illimitato per tutti gli usi leciti." La differenza è sottile e probabilmente strategica , Altman ha chiuso il suo messaggio chiedendo al Pentagono di "offrire le stesse condizioni a tutte le aziende AI," suggerendo che anche Anthropic avrebbe potuto accettare questa formulazione.

Resta un'ambiguità fondamentale: se le leggi americane già proibiscono la sorveglianza di massa e le armi completamente autonome, perché il Pentagono ha rifiutato di metterlo per iscritto nel contratto con Anthropic? La risposta, suggerita da Axios, potrebbe trovarsi in ciò che Emil Michael stava proponendo al telefono: un accordo che avrebbe incluso la raccolta di dati personali degli americani , geolocalizzazione, cronologia web, dati finanziari , acquistati da data broker. Attività tecnicamente legale. Ma che un'AI potrebbe trasformare in sorveglianza di massa de facto.

3. Perché Questa Vicenda È Senza Precedenti

3.1 La prima azienda americana marchiata come "nemica"

La designazione come "supply chain risk" è uno strumento creato per proteggere la catena di approvvigionamento militare da infiltrazioni di governi ostili. I precedenti riguardano esclusivamente aziende legate a potenze avversarie: Huawei, bandita dalla FCC nel 2020 per i legami con il governo cinese; Kaspersky Lab, bandita dal Dipartimento del Commercio nel 2024 per i legami con il governo russo.

Anthropic è un'azienda americana, fondata a San Francisco, valutata 380 miliardi di dollari, che ha appena chiuso un round di finanziamento da 30 miliardi. È sostenuta da investitori come Google e Amazon. Ha volontariamente tagliato ricavi per bloccare l'accesso cinese ai propri modelli. Ha deployato la propria AI per le operazioni classificate dell'esercito americano.

Come ha scritto Charlie Bullock, ricercatore senior all'Institute for Law & AI, il governo non può applicare questa designazione senza aver completato una valutazione del rischio , cosa che non sembra essere avvenuta , e senza aver notificato il Congresso prima di agire , cosa che non sembra sia accaduta. Amos Toh, avvocato senior al Brennan Center for Justice della NYU, ha aggiunto che lo statuto richiede di dimostrare un rischio di sabotaggio, sovversione o manipolazione da parte di un avversario: "Non è affatto chiaro come gli avversari potrebbero sfruttare le restrizioni d'uso di Anthropic su Claude per sabotare i sistemi militari."

3.2 Le ripercussioni sul mercato

Se la designazione venisse applicata nella sua interpretazione più ampia , quella di Hegseth, non quella di Anthropic , le conseguenze sarebbero devastanti. Ogni azienda Fortune 500 con contratti con il Pentagono dovrebbe cessare di utilizzare Claude. Questo potenzialmente include aziende come Amazon, Google e NVIDIA, che hanno investito miliardi di dollari in Anthropic e potrebbero trovarsi obbligate a disinvestire.

Come ha scritto l'analista indipendente Shenaka Anslem Perera: "Ci vorranno anni per risolvere la questione in tribunale. E nel frattempo, ogni general counsel di ogni azienda Fortune 500 con esposizione al Pentagono si farà una sola domanda: usare Claude vale il rischio?"

3.3 Il paradosso del Defense Production Act

La minaccia di invocare il Defense Production Act aggiunge un ulteriore livello di assurdità. Il DPA è una legge del 1950, nata per la Guerra di Corea, che concede al presidente il potere di costringere aziende a dare priorità alla produzione per la difesa nazionale. È stata invocata durante il COVID-19 per aumentare la produzione di ventilatori e mascherine.

Usarla per costringere un'azienda AI a rimuovere salvaguardie di sicurezza dal proprio software è qualcosa che non ha precedenti legali. Ma il paradosso vero è questo: il Pentagono stava contemporaneamente valutando di costringere Anthropic a collaborare tramite il DPA e di bandirla come rischio per la sicurezza nazionale. Come ha notato Amodei, le due posizioni si escludono a vicenda: o Claude è indispensabile per la sicurezza nazionale (e allora va requisito), o è un rischio (e allora va bandito). Non può essere entrambe le cose.

4. La Reazione della Silicon Valley e di Washington

4.1 L'industria si schiera (quasi tutta) con Anthropic

Un fatto notevole di questa vicenda è che l'industria AI , normalmente divisa in fazioni competitive , si è largamente allineata con Anthropic. Persino i rivali diretti.

Sam Altman di OpenAI ha dichiarato di non ritenere che "il Pentagono dovrebbe minacciare il DPA contro queste aziende" e di condividere le preoccupazioni di Anthropic. Ha aggiunto: "Per tutte le differenze che ho con Anthropic, mi fido sostanzialmente di loro come azienda, e penso che si preoccupino davvero della sicurezza."

Jensen Huang, CEO di NVIDIA , azienda che ha investito in Anthropic , ha detto di sperare in un accordo, ma ha aggiunto che "se non si risolve, non è la fine del mondo" poiché esistono altri fornitori AI per il Pentagono.

Dipendenti di Google sono usciti pubblicamente a supporto di Anthropic, sebbene Google stessa , che ha un proprio contratto con il Pentagono , non abbia commentato.

4.2 Il Congresso si divide

La reazione del Congresso ha seguito le linee di faglia prevedibili, ma con qualche sorpresa.

I senatori Ed Markey e Chris Van Hollen hanno scritto a Hegseth che le minacce del Pentagono "rappresentano un agghiacciante abuso del potere governativo." Il senatore Mark Warner, ranking member della Commissione Intelligence, ha dichiarato che la direttiva di Trump "solleva serie preoccupazioni su se le decisioni di sicurezza nazionale siano guidate da un'analisi attenta o da considerazioni politiche" , e ha suggerito che la mossa potrebbe essere un "pretesto per indirizzare contratti verso un fornitore preferito," un probabile riferimento alla xAI di Elon Musk.

La rappresentante Valerie Foushee, co-presidente della Commissione AI, ha definito "profondamente preoccupante" la pressione del Pentagono.

Membri di vertice della Commissione Forze Armate del Senato hanno inviato una lettera privata sia ad Anthropic che al Pentagono, esortandoli a trovare una soluzione.

4.3 Palantir e il domino

Un dettaglio che molte analisi hanno trascurato: la designazione di Anthropic come supply chain risk crea un problema immediato per Palantir Technologies , l'azienda di sorveglianza che abbiamo analizzato in un precedente articolo di Network Caffè. Palantir utilizza Claude per alimentare il suo lavoro più sensibile con il Pentagono, incluse le piattaforme Gotham e AIP usate per intelligence, pianificazione operativa e , come ammette lo stesso CEO Alex Karp , per "rendere l'America più letale."

Se la designazione viene applicata, Palantir dovrà trovare rapidamente un'alternativa a Claude per tutti i suoi contratti militari. Un funzionario del Pentagono ha indicato che Grok, l'AI di Elon Musk, "è pronta per essere usata in ambiente classificato," ma è opinione diffusa che Grok non sia al livello tecnico di Claude.

L'ironia? La stessa Palantir , che non ha mai posto alcun limite etico all'uso della sua tecnologia per sorveglianza o armi autonome , si trova ora in difficoltà perché il suo software dipendeva da un'azienda che quei limiti li ha posti.

5. La Questione di Fondo: Chi Decide Come Si Usa l'AI?

5.1 Il precedente storico: Project Maven

Per chi lavora nel settore, questa storia ha un eco familiare. Nel 2018, Google si ritirò dal Project Maven, un programma del Pentagono per l'analisi di immagini da droni tramite AI, dopo le proteste di migliaia di dipendenti che firmarono una lettera interna dichiarando: "Crediamo che Google non debba essere nel business della guerra."

La differenza tra il 2018 e il 2026 è nel livello di escalation. Allora, Google si ritirò volontariamente e il Pentagono trovò altri fornitori senza drammi. Oggi, un'azienda che cerca di mantenere limiti etici viene marchiata come nemica della nazione.

Il messaggio è chiaro: nel 2018, un'azienda AI poteva dire "no" al Pentagono senza conseguenze. Nel 2026, dire "no" significa essere equiparata a Huawei.

5.2 Il dilemma democratico

La posizione del Pentagono, ridotta all'essenziale, è: "Una volta che compriamo un prodotto, decidiamo noi come usarlo. Abbiamo le nostre procedure e i nostri standard."

La posizione di Anthropic è: "Le leggi non hanno ancora raggiunto le capacità dell'AI. Quello che è tecnicamente legale oggi può essere incompatibile con i valori democratici, e i modelli attuali non sono abbastanza affidabili per certe applicazioni."

Entrambe le posizioni hanno una loro logica. Il problema è che si scontrano su un terreno dove non esistono ancora regole chiare. Come ha osservato Gregory Allen, consigliere senior al Center for Strategic and International Studies: "Gli utilizzatori all'interno del Dipartimento della Difesa amano Anthropic, amano Claude, e dicono che le restrizioni d'uso, almeno dalle conversazioni che ho avuto, non sono mai state attivate."

In altre parole: le due clausole di Anthropic non hanno mai creato un problema operativo concreto. Il Pentagono sta combattendo per il principio di avere accesso illimitato, non per una necessità operativa dimostrata.

Questo rende lo scontro ancora più significativo. Non si tratta di un caso specifico in cui le restrizioni di Anthropic hanno impedito un'operazione militare. Si tratta della domanda fondamentale: un'azienda privata ha il diritto di porre limiti etici alla tecnologia che vende al governo? E se sì, il governo ha il diritto di punirla per averlo fatto?

5.3 La zona grigia

Il portavoce del Pentagono, Sean Parnell, ha dichiarato che il Dipartimento "non ha alcun interesse" a usare l'AI per armi completamente autonome o sorveglianza di massa, sottolineando che quest'ultima è già illegale. Se è così, perché non accettare di metterlo per iscritto?

La risposta sta nelle "zone grigie" che il Pentagono stesso ha citato come motivo per non accettare le clausole. Che cosa conta come "sorveglianza di massa"? L'acquisto legale di dati di geolocalizzazione di milioni di americani da data broker è sorveglianza di massa? Oggi, probabilmente no in senso legale. Ma se quei dati vengono processati da un'AI capace di ricostruire automaticamente i movimenti, le abitudini e le associazioni di ogni singolo individuo, la risposta potrebbe cambiare.

La stessa ambiguità riguarda le armi autonome. Un drone con AI che identifica bersagli e li presenta a un operatore umano per approvazione è un'arma semi-autonoma , e Anthropic non si oppone al suo utilizzo. Ma dove finisce la semi-autonomia e inizia la piena autonomia? Quando il tempo tra la selezione del bersaglio e l'approvazione umana si riduce a secondi? Quando l'operatore approva 50 bersagli all'ora generati da un algoritmo senza il tempo di valutarli singolarmente?

Queste non sono domande teoriche. Sono le domande che definiranno la guerra del XXI secolo. E in questo momento, un'azienda di San Francisco è l'unica che sta chiedendo di affrontarle prima di procedere.

6. Le Implicazioni Legali: Un Terreno Inesplorato

6.1 La designazione come supply chain risk

L'arma più devastante nell'arsenale del Pentagono non è la cancellazione del contratto , 200 milioni di dollari sono una cifra gestibile per un'azienda valutata 380 miliardi. L'arma vera è la designazione come supply chain risk.

Se applicata nell'interpretazione più ampia, ogni azienda che lavora con il Pentagono , e indirettamente, con qualsiasi agenzia federale , dovrebbe certificare di non utilizzare tecnologia Anthropic. Questo non colpirebbe solo i contratti militari di Anthropic, ma potenzialmente l'intera base clienti enterprise: le stesse aziende che usano Claude per programmazione, analisi dati, assistenza clienti e che hanno anche contratti governativi.

Antropic ha contestato questa interpretazione, argomentando che lo statuto (10 USC 3252) limita la designazione ai contratti del Dipartimento della Difesa e "non può influenzare il modo in cui i contractor usano Claude per servire altri clienti." Ma in un clima politico dove il Presidente minaccia "gravi conseguenze civili e penali," quante aziende vorranno rischiare di verificare chi ha ragione?

Diversi esperti legali hanno messo in dubbio la base giuridica della designazione. Lo statuto richiede una valutazione del rischio formale e la notifica al Congresso , requisiti che non sembrano essere stati soddisfatti. Richiede inoltre la prova di un rischio di sabotaggio o manipolazione da parte di un avversario , condizione difficile da sostenere per un'azienda che ha volontariamente tagliato l'accesso ai clienti cinesi.

6.2 La battaglia legale che viene

Anthropic ha annunciato che impugnerà la designazione in tribunale. La causa potrebbe diventare un landmark case per il diritto tecnologico americano, ponendo questioni fondamentali: il governo può usare designazioni di sicurezza nazionale come strumento punitivo contro aziende che esercitano la propria libertà contrattuale? Può costringere un'azienda a rimuovere salvaguardie di sicurezza dal proprio software?

Ma come ha osservato l'analista citato da Fortune, i tempi della giustizia giocano contro Anthropic: "Ci vorranno anni per risolvere in tribunale. E nel frattempo, il danno al business potrebbe essere già fatto."

7. Il Quadro Più Ampio: L'AI Come Nuova Arena della Guerra Fredda Tecnologica

Questa vicenda non avviene nel vuoto. Si inserisce in un contesto in cui l'intelligenza artificiale è diventata il fronte principale della competizione geopolitica tra Stati Uniti e Cina.

L'amministrazione Trump ha ripetutamente definito la corsa all'AI come "equivalente alla corsa allo spazio durante la Guerra Fredda." In questo quadro, qualsiasi ostacolo all'adozione militare dell'AI viene percepito come un vantaggio concesso alla Cina.

Ma il paradosso è lampante: punire una delle aziende AI americane più avanzate, potenzialmente costringendo investitori come Google e Amazon a disinvestire, potenzialmente distruggendo la base enterprise che finanzia la ricerca, è esattamente il tipo di autolesionismo che avvantaggia la Cina. Come ha detto Gregory Allen al CSIS: "Prendere un campione nazionale dell'AI in un momento in cui la Casa Bianca dice che la corsa all'AI con la Cina è equivalente alla corsa allo spazio... non vuoi prendere uno dei gioielli della corona della tua industria e dargli fuoco per qualcosa del genere."

Il senatore Warner è andato oltre, suggerendo che le mosse contro Anthropic "pongono un enorme rischio per la prontezza della difesa americana e per la volontà del settore privato e dell'accademia di lavorare con l'intelligence community e il Dipartimento della Difesa."

Il rischio, in sostanza, è che la punizione esemplare di Anthropic abbia l'effetto opposto a quello desiderato: non rendere le aziende AI più obbedienti, ma convincerle che lavorare con il Pentagono non vale il rischio. Come ha detto Lauren Kahn del Center for Security and Emerging Technology: "Sono davvero, sinceramente preoccupata che le aziende private diranno 'non vale la pena lavorare con il settore della difesa.'"

8. Le Domande che Rimangono Aperte

Al momento in cui scriviamo , 1° marzo 2026 , la situazione è in piena evoluzione. Le domande senza risposta sono numerose:

La designazione sarà formalizzata? Anthropic ha dichiarato di non aver ancora ricevuto comunicazione diretta dal Pentagono o dalla Casa Bianca. Axios ha riportato che le procedure formali non erano ancora state avviate al momento dell'annuncio di Hegseth su X. Il processo legale richiesto dalla legge , valutazione del rischio, notifica al Congresso, esaurimento delle alternative meno intrusive , non sembra essere stato seguito.

Quale sarà l'impatto sui contractor? Aziende come Palantir, Lockheed Martin, Boeing, e gli stessi investitori di Anthropic (Amazon, Google, NVIDIA) dovranno navigare un terreno legale incerto. La battaglia sarà sull'interpretazione: la designazione copre solo l'uso di Claude nei contratti militari, come sostiene Anthropic? O si estende a qualsiasi attività commerciale con Anthropic, come dichiara Hegseth?

L'accordo OpenAI reggerà? Se il Pentagono ha effettivamente accettato le stesse limitazioni di Anthropic nel contratto con OpenAI , anche se formulate diversamente , potrebbe trovarsi nella stessa posizione in futuro. A meno che le "stesse limitazioni" non siano poi così simili nella pratica.

Il Congresso interverrà? Diversi legislatori di entrambi gli schieramenti hanno espresso preoccupazione. Ma l'attuale composizione del Congresso rende improbabile un intervento legislativo diretto.

Anthropic sopravviverà economicamente? La perdita del contratto da 200 milioni non è esistenziale per un'azienda valutata 380 miliardi. Ma se l'interpretazione estensiva della designazione dovesse reggere, l'erosione della base clienti enterprise potrebbe essere devastante. Una IPO, che sembrava imminente, diventerebbe molto più complessa.

9. Conclusioni: La Scelta che Definirà l'Era dell'AI

Questa storia parla di un contratto da 200 milioni di dollari, ma in realtà parla di molto di più. Parla del rapporto tra democrazia e tecnologia. Tra potere pubblico e innovazione privata. Tra sicurezza nazionale e diritti civili.

Anthropic non è un'organizzazione no-profit idealista. È un'azienda a scopo di lucro, valutata quasi 400 miliardi di dollari, che vuole dominare il mercato dell'AI enterprise. La sua presa di posizione non è puro altruismo , è anche un'operazione di posizionamento che differenzia il brand in un mercato dove tutti i competitor hanno già ceduto alle richieste del Pentagono.

Ma questa non è una ragione per sminuire la sostanza della scelta. OpenAI e Google hanno rimosso le proibizioni sull'uso militare dalle loro policy, lasciando Anthropic come l'ultima grande azienda AI a dire "no." In un settore dove il consenso è la norma, la dissidenza ha un valore a prescindere dalle motivazioni.

La domanda vera, quella che questa vicenda costringe tutti noi a porci, è più scomoda: vogliamo un futuro in cui l'intelligenza artificiale più avanzata del pianeta può essere usata per processare automaticamente i dati personali di milioni di cittadini senza le garanzie che un contratto esplicito fornirebbe? Vogliamo armi che decidono chi vive e chi muore alla velocità di un processore, senza che un essere umano prema il pulsante?

Come ha scritto Amodei: "In un ristretto numero di casi, crediamo che l'AI possa minare, piuttosto che difendere, i valori democratici."

Noi di Network Caffè crediamo che quella frase meriti di essere scolpita nel marmo dell'era digitale. Non perché Anthropic sia perfetta , nessuna corporation da 380 miliardi lo è. Ma perché in un momento in cui il potere chiede alla tecnologia di togliersi tutti i limiti, qualcuno deve avere il coraggio di dire: "No. Non tutto ciò che è lecito è giusto. Non tutto ciò che è possibile è desiderabile."

Henry Ford diceva che "il vero progresso avviene solo quando i vantaggi di una nuova tecnologia diventano disponibili per tutti." L'opposto del progresso è quando i vantaggi di una nuova tecnologia diventano strumenti di controllo sui tutti.

Questa battaglia è appena iniziata. Le sue conseguenze definiranno il rapporto tra democrazia e intelligenza artificiale per i decenni a venire.

Sta a noi decidere da che parte stare.

Bibliografia:

Anthropic (26 febbraio 2026). "Statement from Dario Amodei on our discussions with the Department of War"

Anthropic (27 febbraio 2026). "Statement on the comments from Secretary of War Pete Hegseth"

Axios (27 febbraio 2026). "Trump moves to blacklist Anthropic's Claude from government work"

CNN Business (27 febbraio 2026). "Anthropic rejects latest Pentagon offer: 'We cannot in good conscience accede to their request'"

CNN Business (27 febbraio 2026). "Trump administration orders military contractors and federal agencies to cease business with Anthropic"

NPR (27 febbraio 2026). "OpenAI announces Pentagon deal after Trump bans Anthropic"

Fortune (28 febbraio 2026). "OpenAI sweeps in to snag Pentagon contract after Anthropic labeled 'supply chain risk' in unprecedented move"

CNBC (27 febbraio 2026). "Anthropic faces lose-lose scenario in Pentagon conflict"

TechCrunch (27 febbraio 2026). "Pentagon moves to designate Anthropic as a supply-chain risk"

CBS News (27 febbraio 2026). "Hegseth declares Anthropic a supply chain risk"

NBC News (27 febbraio 2026). "OpenAI strikes deal with Pentagon after Trump orders government to stop using Anthropic"

The Hill (27 febbraio 2026). "Anthropic to challenge Pentagon's supply chain risk tag"

Breaking Defense (27 febbraio 2026). "Hegseth labels Anthropic a supply chain risk"

ABC News (27 febbraio 2026). "Trump orders US government to cut ties with Anthropic"

Washington Post (28 febbraio 2026). "Pentagon's Anthropic fight reshapes its relations with Silicon Valley"

CNBC (27 febbraio 2026). "Pentagon-Anthropic AI standoff is real-time testing balance of power in future of warfare"

TechPolicy.Press (28 febbraio 2026). "A Timeline of the Anthropic-Pentagon Dispute"

Axios (27 febbraio 2026). "What Trump labeling Anthropic AI a supply chain risk means"

Rolling Stone (27 febbraio 2026). "Anthropic Defies Pentagon's Demands as Contract Deadline Looms"